OpenAI-CTO Mira Murati: Sora wurde mit allen verfügbaren Videos trainiert

Instagram, Facebook, Shutterstock – Sora wurden mit allem verfügbaren Material trainiert und soll noch dieses Jahr veröffentlicht werden.

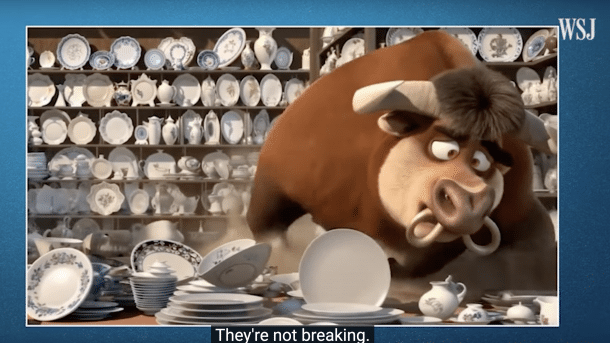

Der Bulle läuft über das Porzellan, doch das zerbricht nicht. Das Video ist mit Sora erstellt worden.

(Bild: Screenshot WSJ Video)

In einem Interview mit dem Wall Street Journal plaudert OpenAIs CTO Mira Murati recht offen über Sora. Schmallippig wird sie allerdings bei der Frage nach den Trainingsdaten des Videogenerators. Wenn sie öffentlich verfügbar waren, können auch Videos von Instagram oder Facebook beim Training verwendet worden sein. "Vielleicht." Sora soll außerdem noch in diesem Jahr verfügbar gemacht werden – für Preise, die denen von Dall-E ähneln. Allerdings ist es laut Murati "viel, viel teurer" ein Video zu generieren als Dall-E oder ChatGPT zu nutzen.

Die Journalistin und Interviewerin Joanna Stern hat OpenAI gebeten, vier Videos zu generieren. Sie sind ganz typisch zunächst beeindruckend, haben aber bei genauerem Hinsehen zahlreiche Macken. Ein Auto wechselt die Farbe, im Prompt heißt es, ein Roboter soll einer Frau die Kamera aus der Hand nehmen, stattdessen wird die Frau zu einem Roboter. Es gibt Hände mit etwa 15 Fingern. Ein Bulle, der über Porzellan läuft, macht das Geschirr nicht kaputt. Dabei erinnert der Bulle ziemlich unweigerlich an die Comicfigur Ferdinand – das ist der Bulle, der gerne an Blumen riecht.

Entsprechend fragt Stern nach dem Trainingsmaterial. Youtube? Murati weiß es nicht. Facebook und Instagram? "Möglich. Wenn es öffentlich zugänglich war." Shutterstock? Auch das weiß Murati nicht, die Information wird laut Video aber nachgereicht: Ja, lizenziertes Material von Shutterstock ist eingeflossen. Murati sagt, solange es frei verfügbar war, kann alles eingeflossen sein.

Die Ähnlichkeit zwischen dem Sora-Bullen und Ferdinand ist kein Einzelfall. Generative KI geht derzeit immer mit der Frage nach dem Urheberrecht einher. Hinzu kommt die Überlegung, welche Videos von privaten Personen eingeflossen sind und ebenso, ähnlich wie der Bulle, in einem neuen Kontext wiedergegeben werden könnten.

Sora kommt noch dieses Jahr – aber bleibt ohne Audio

Videos mit Sora soll noch in diesem Jahr jeder generieren können. Wann genau der Videogenerator verfügbar sein wird, ist aber noch unklar. Ob vor oder nach den US-Präsidentschaftswahlen, bleibt offen. Auch Murati sieht das Missbrauchspotenzial generativer KI. Entsprechend arbeitet man derzeit am Red Teaming, also an Tests, um Schranken und Leitplanken einzuziehen. OpenAI forsche zudem, wie man KI-generierte Inhalte mit Wasserzeichen versehen kann beziehungsweise die Echtheit und Herkunft von Texten, Bilder, Audio und Video verifizieren kann. Erst kürzlich hat OpenAI den Standard C2PA integriert, in den Metadaten steht nun etwa, dass es sich um generierte Bilder handelt. Solche Metadaten lassen sich allerdings freilich leicht entfernen.

Zu den bisher offenen Fragen gehörte auch, wie lange Sora braucht, um ein Video zu generieren. Das hängt laut Murati ganz von der Komplexität des Prompts ab, es sind aber eher mehrere Minuten. Aus dem Interview, das bei Youtube verfügbar ist, können wir erfahren, dass derzeit nicht an einer passenden Audiospur gearbeitet wird. Ton ist erstmal nicht vorgesehen. Dafür müsse die Qualität noch deutlich gesteigert werden. Murati erklärt, Sora funktioniert wie klassischer Film, einzelne Bilder laufen nacheinander, der Videogenerator sei besonders gut darin, die Konsistenz dazwischen herzustellen – aber nicht perfekt.

(emw)